En el presente trabajo se describe el uso de un neurotransmisor para operar a distancia un robot móvil. El objetivo principal de este trabajo es probar el uso del neurotransmisor para manipular un mecanismo, en este caso un robot móvil. El uso de dispositivos de neurotransmisión que capta los impulsos eléctricos emitidos por el cerebro humano ofrece la posibilidad de controlar un dispositivo robótico móvil aplicando las señales de un sistema de electroencefalografía interpretadas mediante una interfaz cerebro–ordenador. Se utilizaron tres tipos de manipulación: mediante movimientos de la cabeza detectados por un giroscopio incluido en la diadema del neurotransmisor, mediante gestos faciales y utilizando las ondas cerebrales captadas por los sensores del neurotransmisor.

Palabras clave: Neurotransmisor, ondas cerebrales, robot móvil.In this paper the use of a neurotransmitter described for remotely operating a mobile robot. The main objective of this study is to test the use of the neurotransmitter to manipulate a mechanism, in this case a mobile robot. The use of devices neurotransmission that captures the electrical impulses emitted by the human brain offers the possibility of controlling a mobile robotic device signals using electroencephalography system interpreted by a brain-computer interface. Three types of controls were used: by head movements detected by a gyroscope included in diadem neurotransmitter, by using facial gestures and brain waves captured by the sensors of the neurotransmitter.

Keywords: Neurotransmitter, brainwave, mobile robot.En 1929, Hans Berger aplicó por primera vez la técnica de la electroencefalografía, esta se ha utilizado fundamentalmente por médicos y científicos para investigar el funcionamiento del cerebro (Hornero, Corralejo, & Álvarez, 2012). Se ha especulado sobre la posibilidad de usar el electroencefalograma (EEG) para descifrar intenciones de un ser humano, de forma que una persona pudiera controlar determinados dispositivos a partir de su actividad cerebral (Darrof, Fenichel, Jankovic, & Mazziotta, 2012).

Una interfaz cerebro-ordenador (BCI por sus siglas en inglés Brain-Computer Interface) es un sistema de comunicación que monitorea la actividad cerebral y traduce determinadas características correspondientes a las intenciones del usuario en comandos de control de un dispositivo.

El neurocontrol puede usarse como una nueva forma de comunicación entre personas y diferentes dispositivos programables, de esta forma podemos realizar diferentes tareas de una manera más sencilla y eliminar algunos accionamientos físicos (Guevara-Mosquera, 2012). Una importante aplicación del neurocontrol es el apoyo a personas con discapacidad en donde es imposible tener movimiento en gran parte del cuerpo, se puede facilitar el movimiento o traslación mediante dispositivos que sean controlados sin necesidad de utilizar ningún tipo de requerimiento físico, por ejemplo, una silla de ruedas eléctrica donde el individuo únicamente tenga que moverla mediante ondas cerebrales que sean procesadas para descifrar su intención (Jiménez, 2013).

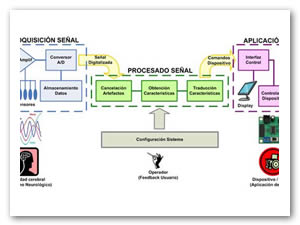

El principio de funcionamiento básico de las interfaces cerebro ordenador, ver Figura 1, se describe en cuatro bloques principales:

Figura 1. Etapas de un BCI

Adquisición de la señal. Bloque donde se adquiere la señal, se amplifica y se realiza la conversión analógica a digital (A/D).

Procesado de la señal. En este bloque se extraen las características de interés de la señal digitalizada para que el dispositivo sobre el que el usuario está actuando sea capaz de interpretar sus órdenes. En este bloque se distinguen tres etapas:

Cancelación de artefactos. Aquí se eliminan los ruidos que provienen de otras actividades bioeléctricas como los movimientos musculares (estas actividades se denominan artefactos) que distorsionan la señal.

Obtención de características. Se traduce la señal de entrada en un vector de características en relación al fenómeno neurológico asociado a la señal.

Traducción de características (decodificación), donde se transforma el vector de características a una señal de control adecuada para el dispositivo que se quiere controlar.

Aplicación. Es el bloque en el que se recibe la señal de control y realiza las acciones correspondientes en el dispositivo a través del controlador del mismo.

Configuración del sistema. Permite al usuario definir los parámetros del sistema.

Las aplicaciones más habituales están dirigidas a facilitar la comunicación, el control de sillas de ruedas y prótesis o el control del entorno. También se han desarrollado aplicaciones orientadas al control del ordenador y la navegación a través de internet.

El desarrollo del proyecto se basa en la utilización de una diadema de neurotransmisión; ésta es una interfaz cerebro-computadora para señales electroencefalográficas (EEG) (EMOTIV, 2015). El equipo Emotiv EPOC es un sistema de detección neuroeléctrica que capta y amplifica ondas cerebrales generadas por diferentes “acciones” mentales y gestos faciales para permitir el control de funciones en una computadora. El sistema también incluye un giroscopio electrónico capaz de detectar con mucha precisión los movimientos de la cabeza del usuario y traducirlos a movimientos del mouse en la pantalla (Holewa & Nawrocka, 2014).

La aplicación Mouse Emulator utiliza un giroscopio integrado al EPOC Neuroheadset para permitir control del mouse de la computadora mediante los movimientos de la cabeza del usuario (Lizama, 2015).

En el panel Expressiv Suite, el sistema interpreta las señales EEG generadas al realizar un gesto facial e identifica esas señales en una base de datos de señales EEG. El sistema también permite enlazar acciones de teclado a la detección de los gestos faciales, por ejemplo, mirar hacia el lado derecho puede presionar la flecha direccional derecha en el teclado (Lizama, 2015).

El panel Cognitiv Suite, mide la actividad cerebral del usuario en tiempo real para detectar un intento consciente de ejecutar una acción física particular en un objeto real o virtual. El sistema es capaz de reconocer hasta 13 acciones diferentes: 6 movimientos direccionales, 6 rotaciones y la acción de “desaparecer”. El usuario puede elegir hasta 4 acciones para ser reconocidas simultáneamente además de la acción “neutral” (no acción) que es obligatoria.

Para el desarrollo del proyecto es necesario considerar el diseño de diferentes componentes, tales como: robot móvil, tarjeta electrónica de control, laberinto y software de control.

El diseño del robot móvil se realizó en el programa SolidWorks; sus dimensiones son 15cm de largo, 15cm de ancho y 10cm de altura. Cuenta con una plataforma elevada por separadores hexagonales de metal en donde se coloca la tarjeta electrónica de control. El prototipo cuenta con tres ruedas, de las cuales dos llantas están colocadas en la parte trasera del prototipo y acopladas a los ejes de motorreductores, cuenta con una tercera llanta que es una rueda loca localizada en la parte delantera. Para la fabricación de las piezas del cuerpo del robot móvil se utilizó alucobond. En la Figura 2, se muestra el prototipo de robot móvil con una cámara integrada, con la cual el usuario dirige la trayectoria.

Figura 2. Prototipo terminado robot móvil

El componente principal de la tarjeta electrónica de control es un microcontrolador PIC 16f877a, esta tarjeta realiza las acciones de procesamiento de los datos recibidos vía bluetooth para determinar el comportamiento de los motores. Se alimenta por una bateria de 5v-1200mAh. El diseño se desarrolló en el programa ARES de Proteus. En la Figura 2, se muestra la tarjeta diseñada en la parte superior del robot.

La etapa de control de motores se implementó por separado, el driver para controlar el sentido de giro de los motorreductores del robot móvil es un puente H; este tipo de driver soporta una corriente máxima DC de 4 A, un voltaje de alimentación de 3-36 V. Las entradas lógicas tienen un voltaje de operación de 3.3 a 5V, las cuales se pueden activar con señales PWM. Además, cuenta con diodos de protección contra inversión de corriente del motor.

Para el diseño del laberinto se utilizó el programa SolidWorks, sus dimensiones son 122cm de largo y 122cm de ancho, los pasillos tienen un ancho de 20cm por lo que permite el desplazamiento del robot móvil; las paredes tienen una altura de 12cm, suficiente para realizar el experimento sin que el usuario pueda ver por encima de las paredes. El laberinto cuenta con una entrada única y una salida única, el único apoyo visual del usuario para encontrar la ruta de salida es la cámara instalada en el prototipo. Para la construcción del laberinto se utilizó MDF de 9mm, en la Figura 3 se puede observar el laberinto concluido en su totalidad.

Figura 3. Laberinto Final

El programa para controlar el robot móvil mediante el neurotransmisor EPOC, denominado “neurocar”, se elaboró en Visual Basic 2010. El programa recibe los datos del panel de control de Emotiv EPOC, vía bluetooth, y ejecutar los movimientos correspondientes a cada acción recibida del usuario. En la Figura 4 se muestra la ventana principal.

Figura 16 Vista Principal del Programa

El programa cuenta con una ventana que utiliza el giroscopio del neurotransmisor, para realizar el control mediante el mouse de la computadora, y enviar el comando al robot móvil: avanzar, retroceder, girar a la derecha o girar a la izquierda. También, cuenta con una ventana para el control por expresiones, ésta recibe comandos directamente de expresiones faciales que realiza el usuario, desde guiñar un ojo, fruncir el ceño, levantar las cejas, sonreír, entre otros. Además, el programa neurocar cuenta con una interfaz para el control cognitivo, los datos son obtenidos directamente del panel de control de Emotiv EPOC. La interfaz cuenta con indicadores que cambian de color al recibir las instrucciones para avanzar, retroceder, girar a la izquierda, girar a la derecha y detenerse.

El objetivo de estas pruebas es determinar la viabilidad de controlar un robot móvil mediante el neurotransmisor y que el usuario nos indique la complejidad de realizar esta tarea. Una forma de medir la dificultad de manipular el robot móvil mediante el neurotransmisor es medir el tiempo que le toma para salir del laberinto.

Se realizaron pruebas con tres sujetos, cada uno experimento con los tres diferentes métodos de control (control por mouse, expresivo y cognitivo). Las pruebas realizadas constan de dos etapas, la primera etapa consta del control del robot móvil mediante una serie de repeticiones sin que el usuario tenga conocimiento previo en las pruebas, y la segunda etapa consta de un entrenamiento previo de horas para familiarizarse con la diadema, el software, el robot móvil y el laberinto.

Control por mouse

Para el control del robot móvil mediante el método de control por mouse a través del giroscopio se realizaron una serie de pruebas. Cada sujeto con los movimientos de la cabeza se traducen en movimientos del robot móvil para guiarlo a la salida del laberinto. Los tiempos de recorrido se pueden observar en la Tabla 1.

| Prueba | Tiempo de salida | Tiempo de salida tras entrenar | ||||

| Sujeto 1 | Sujeto 2 | Sujeto 3 | Sujeto 1 | Sujeto 2 | Sujeto 3 | |

| 1 | 2.52 min | 3.47 min | 1.50 min | 2.20 min | 2.43 min | 1.55 min |

| 2 | 2.16 min | 3.27 min | 2.01 min | 2.10 min | 2.45 min | 2.01 min |

| 3 | 2.46 min | 3.32 min | 2.05 min | 2.04 min | 2.24 min | 2.25 min |

| 4 | 2.47 min | 3.52 min | 2.42 min | 2.19 min | 3.19 min | 1.58 min |

| 5 | 2.38 min | 3.46 min | 2.31 min | 2.13 min | 2.46 min | 1.45 min |

| Promedio | 2.40 min | 3.41 min | 2.06 min | 2.13 min | 2.55 min | 1.77 min |

Tabla 1. Comparación de tiempo (control por mouse)

El promedio total de las pruebas realizadas sin entrenamiento es de 2.40 minutos, 3.41 minutos y 2.06 minutos para el sujeto 1, 2 y 3, respectivamente; mientras que el promedio total con entrenamiento es de 2.13 minutos, 2.55 minutos y 1.77 minutos para el sujeto 1, 2 y 3, respectivamente. Con esto se obtuvo una disminución del tiempo para salir del laberinto en un 11.25%, 25.22% y 14.08% para el sujeto 1, 2 y 3, respectivamente; después de haber entrenado a cada sujeto para realizar las pruebas con método del control por mouse.

Para el método de control por expresiones cada sujeto se sometió, de la misma manera que el control por mouse, a una serie de pruebas sin entrenamiento y posteriormente una serie de pruebas con un entrenamiento previo de 2 horas. Los comandos para la dirigir el robot móvil mediante los gestos faciales se pueden observar en la Tabla 2.

| Gesto | Acción |

| Pestañear | Avanzar |

| Sonreír | Retroceder |

| Sonreír a la Izquierda | Giro Izquierdo |

| Sonreír a la Derecha | Giro Derecho |

Tabla 2. Comandos de control por gestos

Los resultados de esta prueba mediante el método por expresiones aplicado a cada sujeto se pueden observar en la Tabla 3, sin entrenamiento el tiempo de salida promedio es de 21.49 minutos, 21.15 minutos y 18.28 minutos para el sujeto 1, 2 y 3, respectivamente; mientras que el tiempo promedio de salida después del entrenamiento es de 15.53 minutos, 16.29 minutos y 16.52 minutos para el sujeto 1, 2 y 3, respectivamente; como resultado se obtiene una disminución del 27.73%, 22.98% y 9.63% para el sujeto 1, 2 y 3, respectivamente en el tiempo de salida.

| Prueba | Tiempo de salida | Tiempo de salida tras entrenar | ||||

| Sujeto 1 | Sujeto 2 | Sujeto 3 | Sujeto 1 | Sujeto 2 | Sujeto 3 | |

| 1 | 20.34 min | 22.45 min | 18.26 min | 16.35 min | 16.45 min | 15.45 min |

| 2 | 19.23 min | 22.36 min | 18.08 min | 15.55 min | 17.33 min | 16.52 min |

| 3 | 22.14 min | 19.46 min | 18.54 min | 14.06 min | 18.22 min | 17.12 min |

| 4 | 23.25 min | 21.15 min | 17.32 min | 15.44 min | 13.23 min | 17.07 min |

| 5 | 22.47 min | 20.34 min | 19.20 min | 16.26 min | 16.23 min | 16.43 min |

| Promedio | 21.49 min | 21.15 min | 18.28 min | 15.53 min | 16.29 min | 16.52 min |

Tabla 3. Comparación de tiempo (control por expresiones)

En el método de control cognitivo a cada sujeto se le aplicaron cinco pruebas en las cuales tenía que salir del laberinto utilizando únicamente el estado de concentración para dirigir al robot móvil, posteriormente se realizó el entrenamiento de cada sujeto durante dos horas y no se obtuvo ninguna mejora significativa como se puede observar en la Tabla 4.

| Prueba | Tiempo de salida | Tiempo de salida tras entrenar | ||||

| Sujeto 1 | Sujeto 2 | Sujeto 3 | Sujeto 1 | Sujeto 2 | Sujeto 3 | |

| 1 | 40.40 min | 45.32 min | 55.43 min | 46.55 min | 42.32 min | 43.36 min |

| 2 | 49.45 min | 52.25 min | 48.37 min | 57.29 min | 37.42 min | 44.53 min |

| 3 | 55.33 min | 42.53 min | 49.33 min | 48.56 min | 36.20 min | 49.48 min |

| 4 | 42.12 min | 38.15 min | 58.25 min | 43.19 min | 34.25 min | 50.32 min |

| 5 | 48.13 min | 36.12 min | 45.53 min | 46.38 min | 40.25 min | 52.41 min |

| Promedio | 47.08 min | 42.80 min | 51.30 min | 48.39 min | 38.08 min | 48.02 min |

Tabla 4. Comparación de Tiempo Control Cognitivo

El resultado de estas pruebas en el tiempo de salida sin entrenar un promedio de 47.08 minutos, 42.80 minutos y 51.30 minutos para el sujeto 1, 2 y 3, respectivamente; mientras que el tiempo de salida tras entrenar durante un periodo de dos horas es de 48.39 minutos, 38.08 minutos y 48.02 minutos para el sujeto 1, 2 y 3, respectivamente; como resultado podemos observar que el tiempo incremento 2.78%, disminuyo 11.03% y disminuyo 6.39% para el sujeto 1, 2 y 3, respectivamente; después de haber entrenado con el control cognitivo.

El proyecto desarrollado muestra el control de un robot móvil mediante un neurotransmisor de la marca Emotiv EPOC el cual presenta muchas facilidades para ser implementado como un sistema BCI aplicable a robots móviles u otros dispositivos.

La implementación del robot móvil dentro de un laberinto resulto útil para la experimentación de las rutinas realizadas con los sujetos de prueba para implementar de la manipulación mediante el dispositivo de neurocontrol y con ello poder realizar la resolución de un problema tal como es salir del laberinto.

La comunicación del neurotransmisor al robot móvil se realizó mediante el programa desarrollado en Visual Basic en el cual se logró conectar y manipular el robot móvil de manera correcta, con el inconveniente de limitar la distancia de comunicación a tan solo 10 metros de distancia.

Debido a que el control por mouse y el control por expresiones no requieren de mucho entrenamiento, son adecuados para implementarlo con el neurotransmisor para controlar un mecanismo, por otro lado para el control cognitivo se necesita un mayor conocimiento en la parte de entrenamiento de los sujetos de prueba para poder dominar dicho método de manipulación ya que presenta dificultades para su manipulación y el tiempo para el control es considerablemente elevado en comparación con el control por expresiones y el control por mouse.

Se plantea con los resultados obtenidos para el problema de salir de un laberinto como trabajo futuro la implementación de un BCI aplicado a exoesqueletos, prótesis humanas o sillas de ruedas para su control mediante personas con discapacidades, así como también aplicarlo en el campo de la domótica para simplificar muchas de las acciones habituales de hoy en día.

Darrof, R. B., Fenichel, G. M., Jankovic, J., & Mazziotta, J. (2012). Bradley's Neurology in Clinical Practice. Principles of Diagnosis and Manangement. Philadelphia, PA, USA: Elsevier.

EMOTIV. (Octubre de 2015). Obtenido de http://emotiv.com

Guevara-Mosquera, S. D. (2012). Adquisición de señales electroencelográficas para el movimiento de un prototipo de sillas de ruedas en un sistema BCI. Tesis (Ingeniero Electrónico). Cuenca, Ecuador: Universidad Politécnica Salesiana Sede Cuenca.

Holewa, K., & Nawrocka, A. (2014). Emotiv EPOC neuroheadset in brain-computer interface. En 2014 15th International Carpathian Control Conference (ICCC) (págs. 149-152). Velké Karlovice, República Checa.

Hornero, R., Corralejo, R., & Álvarez, D. (2012). Brain-Computer Interface (BCI) aplicado al entrenamiento cognitivo y control domótico para prevenir los efectos del envejecimiento. Lychnos, 1(8), 29-34.

Jiménez. (2013). Desarrollo de un sistema basado en una interfaz cerebro computador para controlar dispositivos mecatrónicos de uso médico orientados a pacientes con discapacidad severa. Tesis (Magíster en Ingeniería), Escuela de Ingeniería. Medellín, Colombia: Universidad EAFIT.

Lizama, M. (Noviembre de 2015). Evaluación de Equipo: Emotiv EPOC. Obtenido de http://pratp.upr.edu/servicios/informacion/tecnologias/informes-tecnicos/pdf/evaluacion -de-equipo-emotiv-epoc-.pdf/view

[a] Profesor Investigador de la Facultad de Ingeniería Electromecánica, de la Universidad de Colima. mduran@ucol.mx; jglau@ucol.mx; scharre@ucol.mx

[b] Becario de la empresa Mar Industrias S.A. de C.V., ubicada en Manzanillo, Colima. dark151293@gmail.com

[c] Profesor Investigador del Área Académica de Ingenierías, en la Escuela Superior de Tlahuelilpan, de la Universidad Autónoma del Estado de Hidalgo. daniel@uaeh.edu.mx