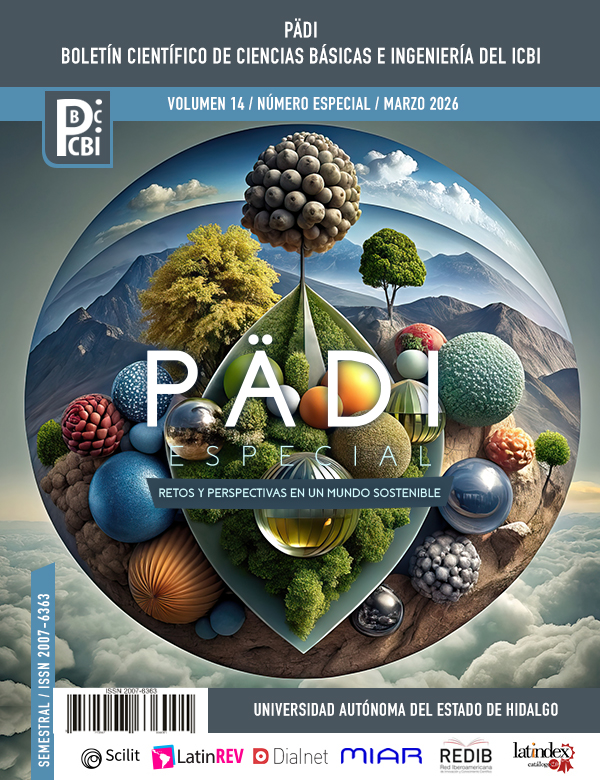

Sistema de visión embebido basado en FPGA para detección de objetos y carriles en vehículo a escala 1:5

DOI:

https://doi.org/10.29057/icbi.v14iEspecial.15463Palabras clave:

Sistemas ADAS, Visión artificial, FPGA, Asistencia a la conducción segura, Percepción visual del entorno vialResumen

Este trabajo presenta el desarrollo e implementación de un sistema de visión embebido basado en FPGA para la detección de carriles y objetos en un vehículo autónomo a escala 1:5. Se utilizó la tarjeta Kria KV260 Vision AI para procesar una red YOLOv3-Tiny y un algoritmo de segmentación de carriles en tiempo real. Las imágenes fueron adquiridas mediante una cámara USB y los resultados se visualizaron en una interfaz gráfica inalámbrica desarrollada para un dispositivo Android. El sistema alcanzó una precisión media del 92.4 % en la detección de vehículos y presentó una latencia menor a 150 ms. La estructura mecánica con aislamiento de vibraciones mejoró significativamente la calidad de imagen. Entre las limitaciones destacan la dependencia de las condiciones de iluminación y la resolución de la cámara utilizada. La plataforma es modular, eficiente y adecuada para aplicaciones académicas y prototipos ADAS de bajo costo, y su diseño permite futuras mejoras, como la integración de sensores adicionales o protocolos de comunicación automotriz, consolidándose como una herramienta versátil para la investigación y la enseñanza en sistemas embebidos de percepción vehicular.

Descargas

Citas

Adiono, T., Putra, A., Sutisna, N., & Syafalni, I. (2021). Low latency YOLOv3-Tiny accelerator for low-cost FPGA using general matrix multiplication principle. IEEE Access, 9, 130102–130114. DOI: 10.1109/ACCESS.2021.3120629

Al Amin, R., Hasan, M., Wiese, V., & Obermaisser, R. (2024). FPGA-based real-time object detection and classification system using YOLO for edge computing. IEEE Access, 12, 102345–102357. DOI: 10.1109/ACCESS.2024.3404623

Ding, C., Wang, S., Liu, N., Xu, K., Wang, Y., & Liang, Y. (2019). REQ-YOLO: A resource-aware, efficient quantization framework for object detection on FPGAs. Proceedings of the 2019 ACM/SIGDA International Symposium on Field-Programmable Gate Arrays, 33–42. DOI: 10.1145/3289602.3293904

Fang, N., Li, L., Zhou, X., Zhang, W., & Chen, F. (2025). An FPGA-based hybrid overlapping acceleration architecture for small-target remote sensing detection. Remote Sensing, 17(3), 494. DOI: 10.3390/rs17030494

Murendeni, T., Phiri, J., & Velempini, M. (2025). Vision-based autonomous vehicle detection system using deep learning: A review. Sensors, 25(6), 2540. DOI: 10.3390/s25062540

Sharma, S., Guleria, K., Tiwari, S., & Kumar, S. (2024). An enhanced DarkNet53-based YOLOv3 feature pyramid network for real-time object detection. En Proceedings of the 2024 International Conference on Computational Intelligence and Computing Applications (ICCICA), 148–153. DOI: 10.1109/ICCICA60014.2024.10585196

Wei, C., Zhang, T., & Liu, Y. (2018). A review of computer vision technologies for advanced driver assistance systems. IEEE Transactions on Intelligent Transportation Systems, 19(12), 3925–3940. DOI: 10.1109/TITS.2018.2828883

Yang, X., Zhuang, C., Feng, W., Yang, Z., & Wang, Q. (2023). FPGA implementation of a deep learning acceleration core architecture for image target detection. Applied Sciences, 13(7), 4144. DOI: 10.3390/app13074144

Yu, L., Zhu, J., Zhao, Q., & Wang, Z. (2022). An efficient YOLO algorithm with an attention mechanism for vision-based defect inspection deployed on FPGA. Micromachines, 13(7), 1058. DOI: 10.3390/mi13071058

Zhang, Y., & Lee, S. (2020). Energy-efficient processing for embedded vision systems in autonomous vehicles. Journal of Systems Architecture, 110, 101807.

Zhao, D., Liu, S., Zhang, Z., Zhang, Z., & Tang, L. (2024). Research on ZYNQ neural network acceleration method for aluminium surface microdefects. Digital Signal Processing, 104900. DOI: 10.1016/j.dsp.2024.104900

Descargas

Publicado

Cómo citar

Número

Sección

Licencia

Derechos de autor 2026 Karen Roa-Tort, Josué D. Rivera-Fernández, Diego A. Fabila-Bustos, Adrián Apolonio-Vera, Daniel León-Martínez, Elizama B. Ortega-Gutiérrez, David A. Cano-Ibarra

Esta obra está bajo una licencia internacional Creative Commons Atribución-NoComercial-SinDerivadas 4.0.

Datos de los fondos

-

Secretaría de Investigación y Posgrado, Instituto Politécnico Nacional

Números de la subvención SIP-IPN, 20254116